Ci risiamo. Per la seconda volta in pochi giorni, un contenuto generato da intelligenza artificiale finisce al centro di discussioni pubbliche. Sulla scia di quanto successo a La Provincia, un nuovo episodio ha coinvolto il principale quotidiano in lingua inglese del Pakistan, Dawn, diventato oggetto di grande attenzione il 12 novembre quando i lettori hanno scoperto una frase attribuita a ChatGPT all’interno di un articolo firmato dal giornalista Aamir Shafaat Khan.

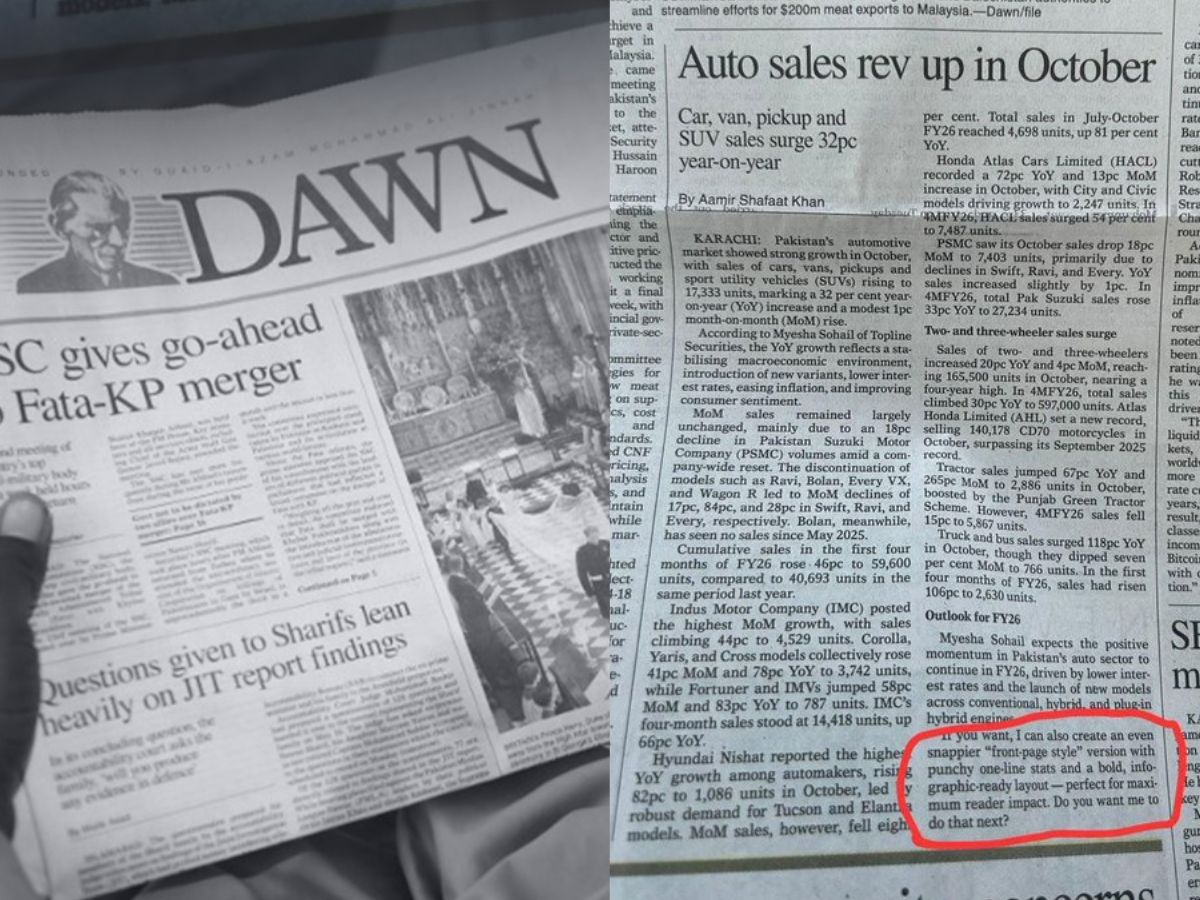

Il quotidiano, fondato nel 1941 da Muhammad Ali Jinnah, aveva pubblicato un pezzo dedicato all’andamento delle vendite di auto. Tutto sembrava rientrare nelle informazioni economiche riportate dal giornale, fino a quando gli utenti non hanno notato, nel paragrafo finale, una frase fuori contesto. Il testo diceva: “Se vuoi, posso anche creare una versione ancora più accattivante in stile ‘prima pagina’, con statistiche incisive su una sola riga e un layout audace e pronto per l’infografica, perfetto per il massimo impatto sul lettore. Vuoi che faccia anche questo?”. La frase appariva come un passaggio scambiato per errore con un messaggio di editing dell’IA.

Una volta scoperta la presenza del testo automatico, l’errore è stato condiviso rapidamente sui social. Molti utenti hanno iniziato a commentare, facendo riferimento al fatto che il messaggio sembrava parte di un processo interno non destinato alla pubblicazione e paragonandolo a un “errore da principianti”. Su Reddit, un lettore pakistano ha scritto: “Mentre leggevo il quotidiano Dawn del 12 novembre, mercoledì, mi sono imbattuto in un articolo in cui ho scoperto l’uso di ChatGPT. È imbarazzante per la carta stampata e, in particolare, per un giornale come DAWN, che gode di un’eccellente reputazione”. Su Instagram, un altro utente ha commentato: “Giornale pakistano sorpreso a usare ChatGPT. Da bambino degli anni ’90, credo che ogni riga del giornale pakistano in inglese sia generata dall’intelligenza artificiale, tranne ‘I ragazzi hanno giocato bene'”.

Quando l’ondata di reazioni è arrivata alla direzione del giornale, il quotidiano ha aggiornato immediatamente la versione digitale del pezzo. Nella nota dell’editore ora visibile online si legge che il rapporto “è stato originariamente modificato utilizzando l’intelligenza artificiale, il che viola la nostra attuale politica sull’intelligenza artificiale”, aggiungendo che “il testo generato dall’IA durante il processo di editing è stato eliminato nella versione digitale”. La nota precisa anche che è stata avviata un’indagine interna e che la redazione esprime “rammarico” per la “violazione della politica aziendale in materia di intelligenza artificiale”.

Sui social, le reazioni sono proseguite. Alcuni utenti hanno scritto che l’episodio avrebbe mostrato una contraddizione tra le regole dichiarate e i contenuti pubblicati. Sulla piattaforma X, un commento diceva: “ChatGPT ha iniziato a creare giornali. È stato persino scoperto per errore”. Un altro post affermava: “Immaginate di fare la predica agli altri sull’’etica nei media’ mentre pubblicate voi stessi articoli generati dall’intelligenza artificiale”. Diversi utenti hanno osservato come il caso alimenti un dibattito in corso sul ruolo degli strumenti automatici nelle redazioni.

Anche su LinkedIn sono stati condivisi messaggi riguardo alle difficoltà delle organizzazioni editoriali nell’adattarsi all’IA, con alcuni professionisti che hanno ricordato l’importanza del controllo delle fonti e del lavoro umano. Un giornalista pakistano ha definito l’incidente “la rovina del giornalismo”, mentre altri lettori hanno parlato dell’episodio come di un esempio della sfida tra procedure tradizionali e nuovi strumenti digitali.